Künstlicher Intelligenz auf die Finger geschaut

Eine automatische und smarte Auswertung von Daten wird in vielen Bereichen gebraucht. Üblicherweise setzt man dazu auf Künstliche Intelligenz, die wiederum vielfach auf Neuronalen Netzen basiert. Was diese bei ihrer Entscheidungsfindung allerdings genau tun, ist in den meisten Fällen unbekannt. Das Fraunhofer FHR untersucht nun die Prozesse, die bislang noch im Dunklen lagen.

Künstliche Intelligenz und Neuronale Netze sind Trendthemen, die sich durch zahlreiche Bereiche ziehen – von der Mobilität über Produktionsprozesse bis hin zur Verteidigung. Schließlich werden die erhobenen Datenmengen zunehmend größer, daher ist stetig mehr Unterstützung bei ihrer Auswertung nötig. Zwar liefern die Neuronalen Netze meist gute Ergebnisse, doch: Üblicherweise ist nicht bekannt, wie sie zu diesen Ergebnissen kommen, die Neuronalen Netze gleichen einer Black Box. Mitunter stützen sie sich auf unwichtige Informationen im Bild – so analysierten die Neuronalen Netze in einem in der Wissenschaftsliteratur beschriebenen Projekt, bei dem es um die Klassifikation von Schiffen in optischen Bildern ging, anstelle der Schiffe das Wasser!

Tun die Neuronalen Netzwerke das, was sie tun sollen? Sind ihre Ergebnisse also verlässlich? Diesen Fragen gehen Forscherinnen und Forscher des Fraunhofer FHR unter dem Thema »Erklärbare KI« oder auch »Explainable AI« nach. Als Basis dienen öffentliche Radardaten, die während zweier Überflüge über ein Feld gewonnen wurden. Auf dem Feld wurden zuvor zehn Ziele platziert – Panzer, LKW, gepanzerte Fahrzeuge sowie ein Bulldozer. Die Radardaten, die während des ersten Überflugs erzeugt wurden, dienten als Trainingsdaten. Beim zweiten Überflug wurden die Testdaten erhoben, allerdings unter einem geänderten Winkel. Die Ziele wurden nicht bewegt, sie verblieben an Ort und Stelle. Es wäre also durchaus möglich, dass die Neuronalen Netze die Radaraufnahmen über den Hintergrund klassifizieren, beispielsweise über einen Baum, der neben dem Panzer steht.

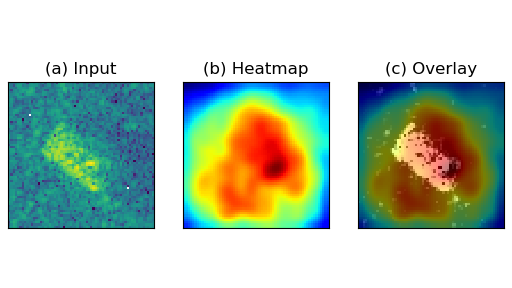

Zur Analyse dienten sowohl Feature Maps als auch Heat Maps. Die Algorithmen dafür sind bekannt, allerdings wurden sie bislang noch nicht auf die Auswertung von Radardaten angewendet. In den Feature Maps werten die Algorithmen die Zwischenergebnisse der einzelnen Lagen aus, in denen die Neuronalen Netze die Daten analysieren. Dabei stehen Besonderheiten wie Kanten oder die Länge des Ziels im Vordergrund. Bei Tiefen Neuronalen Netzen, auch Deep Neural Networks genannt, wird diese Art der Analyse allerdings schnell unübersichtlich, denn: Je tiefer das Netzwerk wird, desto komplexer wird auch die Feature Map. Daher wurden in einer zweiten Analyse alle wichtigen Features, auf die die Neuronalen Netze »schauen«, in einer Heat Map zusammengeführt. Die Ergebnisse sprechen für die Neuronalen Netze des Fraunhofer FHR: Sie analysieren wie gewünscht die Ziele, nicht die Hintergründe.